2026年3月,Google正式关闭了服役近十年的Google Assistant服务,全面转向Gemini AI助手,标志着Google在AI助手领域的战略重塑正式落地-7。许多开发者和学习者对Google AI助手生态的认知仍停留在“会聊天的机器人”层面——只会调用API、不懂Agent原理、分不清Gemini与Gemma的关系。本文将从这一核心痛点切入,系统讲解Google AI助手的演进脉络、核心架构、代码实现与面试要点。

一、痛点切入:为什么需要Google AI助手?

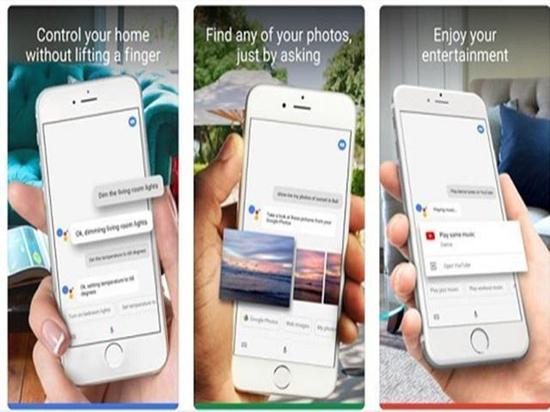

在Google Assistant时代,开发者构建语音交互应用的方式相对传统:通过Actions on Google平台定义Intent和Dialog Flow,前端触发、后端响应,整个流程是静态的、预设的。

传统Google Assistant Action示例(简化)def handle_intent(intent_name, parameters): if intent_name == "weather.query": city = parameters.get("city") return {"fulfillmentText": f"{city}的天气是晴天,25°C"} return {"fulfillmentText": "我没听懂"} 每次只能响应预设的意图,无法自主规划

这种模式的缺点十分明显:

耦合度高:意图与处理逻辑一一绑定,新增功能需重新发布

扩展性差:无法完成“查天气→判断下雨→订伞”这类多步骤任务

上下文有限:每轮对话独立,无法跨任务复用信息

无自主能力:只能回答预设问题,不能主动规划行动

这些痛点促使Google从“命令式助手”转向“代理式AI助手”,即让AI具备自主思考、调用工具、完成复杂任务的能力。

二、核心概念讲解:AI Agent

AI Agent(人工智能代理) 是指能够自主感知环境、做出决策、执行动作并完成目标的智能实体。与普通AI聊天机器人的区别在于:后者“只会说”,前者“能干活”。

用一个生活化类比来理解:

普通AI(如传统Google Assistant):就像百度百科——你问“怎么做红烧肉”,它告诉你步骤,但你需要自己动手。

AI Agent(如Gemini驱动的AI助手):就像私人厨师——你说“我想吃红烧肉”,它自己去买菜、切肉、炒糖色、炖40分钟,最后端给你。

Google在其官方AI Agent白皮书中给出了一个清晰的公式-12:

AI Agent = 大脑(Model)+ 手(Tools)+ 协调系统(Orchestration)| 组件 | 功能 | Google生态中的实例 |

|---|---|---|

| 大脑 | 理解目标、规划步骤、评估结果 | Gemini 3系列模型 |

| 手 | 执行具体操作的工具 | Google、Google Maps、自定义API |

| 协调系统 | 编排大脑与手的协作循环 | ADK(Agent Development Kit) |

三、关联概念讲解:Gemini vs. Gemma vs. Google Assistant

理解Google AI助手生态,必须厘清三个易混淆的概念:

1. Gemini(闭源旗舰模型)

Google最强大的多模态大模型系列,包括Gemini 3.1 Pro、Gemini 3.1 Flash等

可通过Google AI Studio或Vertex AI调用API

2026年3月起全面接管Google Assistant功能-7

2. Gemma(开源轻量模型)

与Gemini共享底层技术,但以Apache 2.0协议开源

可在手机、边缘设备离线运行,支持移动端部署-2

例如Google AI Edge Eloquent即基于Gemma 4 ASR模型实现离线语音转文本-2

3. Google Assistant(已退役)

Google传统语音助手,2026年3月正式关闭

功能已迁移至Gemini,用户现可无缝使用Gemini完成原Assistant的所有操作-7

三者关系一目了然:

| Gemini | Gemma | Google Assistant | |

|---|---|---|---|

| 开源 | ❌ 闭源 | ✅ 开源 | ❌ 已退役 |

| 部署方式 | 云端API | 本地/边缘 | 云端 |

| 定位 | 最强多模态模型 | 轻量开源模型 | 传统语音助手(已取代) |

| 应用场景 | 复杂推理、Agent开发 | 移动端、隐私敏感场景 | 已被Gemini全面替代 |

四、概念关系与区别总结

一句话概括:

Gemini是Google最强的大脑,Gemma是能塞进手机的兄弟,Google Assistant是过去,Agent是未来。

从技术演进角度看:

传统模式:用户发指令 → 助手执行 → 对话结束

Agent模式:用户定目标 → AI自主规划 → 调用工具执行 → 持续迭代 → 任务完成

Google AI助手的演进本质上是从“被动响应”到“主动代理”的范式跃迁。

五、代码示例:调用Gemini API构建AI助手

Google提供官方SDK,支持Python和Node.js。以下是一个完整的API调用示例,展示如何让Gemini执行联网并生成回答-21-26:

import google.generativeai as genai import os 1. 配置API密钥(从Google AI Studio获取) genai.configure(api_key=os.environ.get("GOOGLE_API_KEY")) 2. 选择模型(Gemini 3.1 Flash Lite,速度最快、成本最低) model = genai.GenerativeModel("gemini-3.1-flash-lite") 3. 发起请求(支持联网工具) response = model.generate_content( "2026年4月最新的AI Agent技术进展,并总结三个关键趋势", tools=["google_search"] 启用Google工具 ) 4. 输出结果 print(response.text)

关键步骤解读:

第1-2行:导入SDK并配置API Key。API Key可在Google AI Studio免费生成

第5行:使用

gemini-3.1-flash-lite模型,价格仅$0.25/百万输入tokens,速度是Gemini 2.5 Flash的2.5倍-21第8-11行:通过

tools=["google_search"]启用内置工具,让模型可以主动网络获取实时信息

对比传统Google Assistant的实现方式:

| 维度 | Google Assistant | Gemini API |

|---|---|---|

| 开发方式 | 定义Intent和Dialog Flow | 自然语言Prompt + SDK调用 |

| 工具调用 | 需预设 | 模型自主决策 |

| 上下文管理 | 手动维护 | 自动在上下文中保持 |

| 扩展能力 | 需重新发布Action | 修改Prompt即可 |

六、底层原理与技术支撑

Gemini驱动AI助手实现自主任务的核心底层技术包括:

1. 上下文环流(Context Circulation)

原理:每次工具调用的输入和输出自动保留在模型的上下文窗口中,后续步骤可直接引用前面任何一步的数据-13

价值:无需开发者手动拼接数据,模型自主完成多步串联

2. 内置工具 + 自定义函数混用

Gemini 3支持在同一请求中同时调用Google、Google Maps等内置工具和开发者自定义函数-13

延迟减半,代码量大幅减少

3. 多模态记忆

2026年1月曝光的Gemini Live更新中,模型支持多模态记忆和更好的噪声处理能力-6

Agent可“记住”设备摄像头看到的画面,并在后续对话中引用

这些技术依赖的核心基础设施是Google的Agent Development Kit(ADK) ,为开发者提供从原型到生产的完整工具链-14。

七、高频面试题与参考答案

Q1:Gemini和Gemma有什么区别?

参考答案:Gemini是Google的闭源旗舰大模型系列,通过API提供最强的多模态能力,适合复杂推理和Agent开发。Gemma是Google的开源轻量模型,基于与Gemini共享的技术,以Apache 2.0协议开源,可部署在手机、边缘设备上离线运行。两者的核心差异在于开源状态、部署方式和目标场景。

Q2:什么是AI Agent?Google如何定义Agent的架构?

参考答案:AI Agent是能够自主感知、决策、执行并完成任务的智能实体。Google在官方白皮书中将Agent定义为“大脑(大模型)+ 手(工具)+ 协调系统”三要素。核心运行机制是ReAct模式——每一步先进行推理(Reasoning),再执行动作(Acting),形成持续的思考-行动-观察循环,直到任务完成-12。

Q3:传统Google Assistant和Gemini驱动的AI助手有何本质区别?

参考答案:Google Assistant是“命令-响应”式架构,开发者需要预设意图和对话流程,交互是线性的。Gemini驱动的AI助手采用Agent范式,模型具备自主规划能力,可动态决定调用哪些工具、按什么顺序执行、如何传递上下文。2026年3月Google已正式关闭Assistant,全面转向Gemini。

Q4:如何通过API让Gemini执行联网?

参考答案:在调用generate_content方法时,通过tools参数传入内置工具,如tools=["google_search"]。Gemini会根据用户Prompt自主判断是否需要,并自动调用工具获取实时信息。此功能已在Gemini 3系列API中全面支持。

Q5:Google在2026年对AI助手有哪些关键战略动作?

参考答案:核心动作有三:一是2026年3月正式关闭Google Assistant,全面由Gemini接管;二是发布Gemini 3系列新模型,内置多模态记忆和Agentic模式;三是推出Google AI Edge Eloquent等端侧应用,展示Gemma模型在移动端离线部署能力-2-6-7。

八、结尾总结

本文围绕Google AI助手的技术演进,梳理了以下核心知识点:

| 知识点 | 核心结论 |

|---|---|

| 演进背景 | 2026年3月Google Assistant退役,Gemini全面接管 |

| 核心概念 | AI Agent = 大脑(模型)+ 手(工具)+ 协调系统 |

| 概念区分 | Gemini(闭源旗舰)vs. Gemma(开源轻量)vs. Assistant(已退役) |

| 代码实现 | Python SDK调用Gemini API,支持联网等内置工具 |

| 底层原理 | 上下文环流、工具混用、多模态记忆支撑Agent自主能力 |

| 面试要点 | 理解三要素架构、区分Gemini/Gemma、掌握API调用方式 |

易错点提醒:不要混淆Gemini和Gemma——前者是闭源API模型,后者是开源本地模型;不要认为Google Assistant还能用——2026年3月后已全面下线。

下一篇预告:Google ADK深度解析——如何从零搭建生产级AI Agent。

扫一扫微信交流

扫一扫微信交流